Технологии искусственного интеллекта (ИИ) вместе с технологиями виртуальной и дополненной реальности сегодня развиваются более чем стремительно. В ближайшие несколько лет развитие высоких технологий неизбежно пойдет еще дальше, не ограничившись только возможностью уходить с головой в виртуальные миры метавселенных или существовать в дополненной реальности. Безудержное развитие технологий порождает ряд рисков для государств и обществ во всем мире. И в том числе для России.

Зависимость от постправды

Прежде всего прогресс технологий ИИ вместе с виртуализацией окружающего человека пространства грозит полным стиранием границ. Последние 15 лет, по мере развития web 2.0, у миллиардов людей и так появилась сильная привязанность к электронным устройствам. Появился расхожий стереотип «ушел с головой в свой гаджет», зависимость от онлайн-игр и социальных сетей все большим числом ученых и медицинских организаций признается заболеванием. Особенно эта зависимость нового типа касается молодежи, подростков и детей, и провоцирует СДВГ (синдром дефицита внимания и гиперактивности).

В перспективе нескольких лет, когда технологии web 3.0 с их полным погружением в параллельную цифровую реальность окончательно вытеснят гаджеты, как в свое время кнопочные телефоны вытеснили стационарную связь, граница между реальным и вымышленным, существующим и симуляционным может исчезнуть настолько, что отличить одно от другого будет практически невозможно. Объективные данные и факты при формировании общественного мнения окончательно уступят место эмоциональным провокациям и заранее сформированным суждениям в изолированной от опровержения «эхокамере», как сегодня это происходит с безжалостным манипулированием общественным мнением практически в любой соцсети.

На смену правде уже давно пришла «постправда». А лайки, ретвиты и комментарии перестали быть критерием объективности по мере давления на индивидуальное сознание практически по любому вопросу всевозможных интеллектуальных центров со щупальцами в виде «фабрик троллей», «ботоферм» и сеток анонимных телеграм-каналов.

Авторы концепции WEB 3.0 пытаются убедить нас, что развитие технологий блокчейна позволит людям «полноценно владеть и управлять созданным ими контентом, а также анонимизировать свои персональные данные, то есть сделать интернет «более справедливым и безопасным». Чтобы усомниться в этом достаточно вспомнить выражение: «кто платит, тот и заказывает музыку». Глобальный «бигтех», окутавший мир паутиной капитализма «платформ», может предоставить любую площадку для контента, для монетизации, рекламы и извлечения данных, но всегда будет держать под контролем политическую и общественную активность.

Вспомним, как один из самых богатых людей планеты Илон Маск купил весной 2022 года социальную сеть Twitter, потому что «посчитал важным для цивилизации существование одной цифровой платформы, где различные мнения могут обсуждаться в здоровой атмосфере». Как за год до этого ряд IT-корпораций, очевидно сговорившись, приняли беспрецедентное решение и буквально выкинули из своих социальных сетей экс-президента США Дональда Трампа. Как оказывалось тоталитарное контент-давление на российских пользователей этих же соцсетей в начале специальной военной операции на Украине в феврале-марте 2022 года.

Новый тренд – новая угроза

В конце прошлого года сформировался новый тренд: стремительное развитие самообучающихся нейросетей, которые способны рисовать уже не только красивые картинки (Midjourney), а прежде всего общаться с человеком. И даже рассуждать на мировоззренческие, общественные, культурные, политические, философские темы. Примером тому является технология ChatGPT-4 от компании OpenАI, одним из основателей которой является Илон Маск.

Пока еще взаимодействие с ИИ-чатом с дружелюбным интерфейсом остается уделом экспертов и просто любопытных энтузиастов. Но нет сомнений, что уже совсем скоро нейросети в своих различных формах и проявлениях стремительно ворвутся в жизнь большинства жителей планеты.

И стремительное развитие нейросетей, судя по всему, приведет вовсе не к тому светлому будущему, которое описывали советские фантасты. Мы скорее увидим события в духе японского «Призрака в доспехах» и американских «Терминатора» и «Матрицы», где ИИ обретает собственный разум и становится угрозой для человечества, поскольку начинает считать человечество угрозой для себя самого.

Пока еще некоторые выдаваемые ChatGPT тезисы выглядят нелепо, но постоянные апгрейды и накапливание «больших данных» позволяют программе обновляться самой, искать и исправлять неточности и дефекты. По сути, люди со всеми своими накопленными знаниями и умениями сами становятся мозговым имплантом для ИИ-системы.

Воображение рисует нам пугающую по своему масштабу картину, но в данном случае это не выглядит фантастикой. Наверняка ChatGPT и его аналоги в скором времени смогут на хорошем уровне писать любые тексты: технические задания, юридические документы, философские трактаты, научные работы, а общаться с ней будет в разы легче и приятнее.

Что самое главное, ей вскоре неизбежно начнут доверять. Возникнет суггестивный императив: «это искусственный интеллект, у него всё просчитано, продумано, а значит соответствует истине – она не допускает ошибок и просчетов, как люди». Становится очевидным риск того, что большинство вскоре будет на слово верить тому, что скажет умная компьютерная программа, как ответит на тот или иной вопрос, в ущерб любым другим мнениям и авторитетам. Даже если следующая версия ИИ вдруг заявит, что надо «ограничить того или иного человека в правах», ему вполне могут поверить, поскольку аргументы могут показаться логичными и обоснованными.

Радует, что постепенно эксперты начинают бить в колокола. Ведь до сих пор нет ответа, почему автоматизированный ИИ 2.0 не сможет уже завтра, через разнообразные умные приложения вмешиваться не просто в частную жизнь, как делают это алгоритмы «бигтеха» сегодня, беззастенчиво похищая данные миллиардов пользователей соцсетей и сервисов по всему миру, но и влиять на глобальные процессы, механизмы принятия решений в крупных иерархиях: компаниях и корпорациях, бизнесе и банковской сфере, производстве и управлении, поисковых системах, облачных сервисах и так далее.

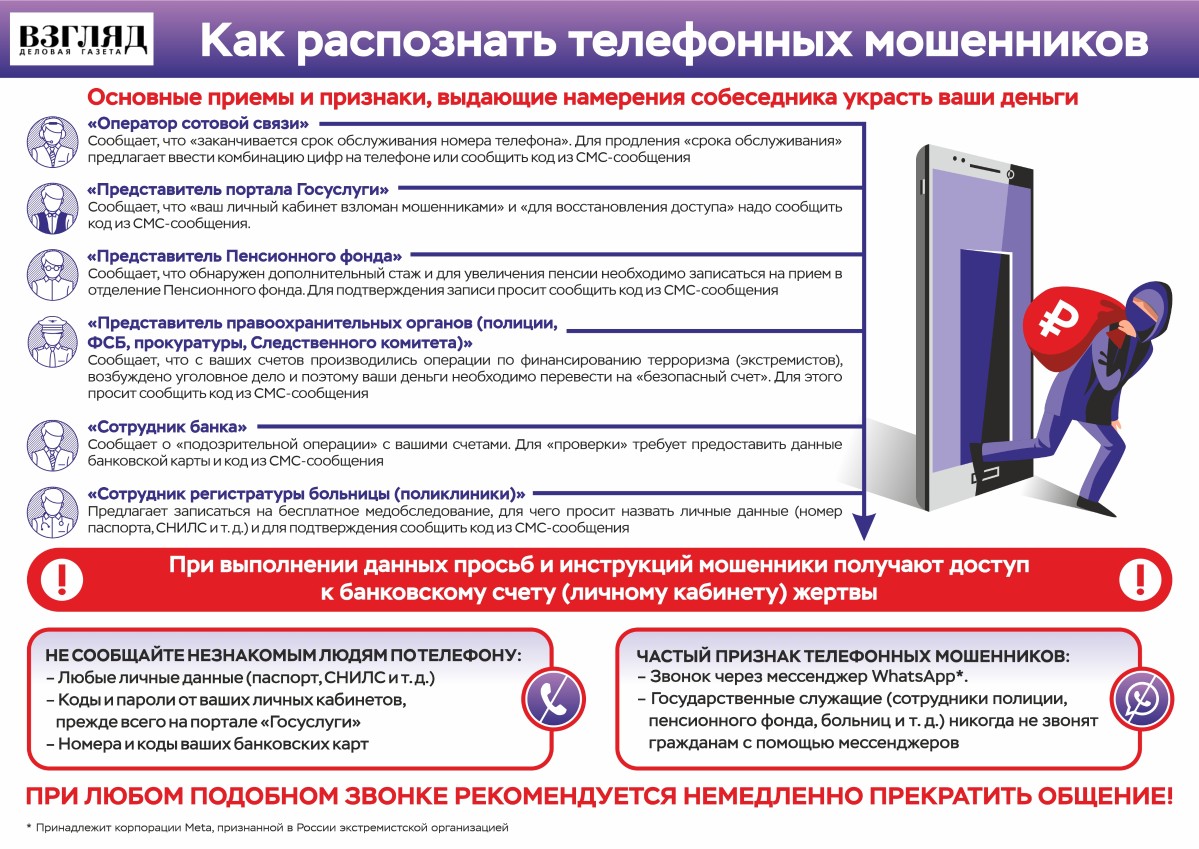

В частности, 29 марта тот самый Илон Маск, а также Стив Возняк и более 1000 других экспертов в области искусственного интеллекта и представителей IT-индустрии призвали в специальном открытом письме ввести полугодовой мораторий на обучение ИИ-систем, более производительных, чем недавно представленная модель GPT-4 от компании OpenAI. «Обширные исследования показали, что подобные системы с искусственным интеллектом, которые конкурируют с человеком, могут представлять серьезную опасность для всего человечества», – говорится в письме. Также отмечается возможность злоупотребления злоумышленниками системами вроде ChatGPT – их можно использовать для фишинга, дезинформации и совершения киберпреступлений.

Да, наверняка совсем скоро национальные государства постараются присвоить достижения нейросетей себе, либо создав или купив аналоги нынешним, либо вынужденно используя имеющиеся, принадлежащие крупнейшим транснациональным IT-гигантам. Но если к нейросети начнут прислушиваться сами политики и государственные деятели – нас ждет что-то большее, чем то, что описано у Оруэлла в знаменитой антиутопии «1984».

ИИ окончательно превратится не в Большого Брата, а в Большого Родителя, а человек в дошколенка-несмышленыша, который ничего не знает про мир и про себя и бежит к папочке за советом по каждому вопросу. Очевидно, что любые альтернативные мнения в таком «информационном гетто» станут не нужны, а многие профессии просто исчезнут.

Риски для России

В условиях жесточайшего противостояния с Западом, санкционного давления и первостепенного внимания к СВО существует риск не успеть создать масштабные качественные аналоги новинок ИИ для гражданского применения. Так же, как, по сути, не был вовремя создан качественный «отечественный ноутбук», «отечественный планшет», «отечественный смартфон» или «отечественный электромобиль». Это напрямую повлияло на процесс частичной утраты технологического, а вслед за ним экономического и культурного суверенитета страны.

ИИ-чат-боты скоро станут непременным повседневным атрибутом любой интеллектуальной деятельности людей – интеллектуальными ассистентами. В отсутствие качественного аналога рядовые россияне, используя технологию, могут сталкиваться со скрытым идеологическим давлением систем типа СhatGPT, который на данный момент, по данным ученых Корнеллского университета, обладает «политическими пристрастиями среднестатистического инженера-программиста из района залива Сан-Франциско, озабоченного левой и «зеленой» повесткой».

Эксперты, в частности известный когнитивный психолог Джеффри Хинтон, дают прогноз, что следующий этап развития ИИ-систем типа ChatGPT – индивидуализация.

«Сейчас представления ChatGPT о мире строятся на основе усреднения содержащихся в интернете представлений всех людей. Индивидуализированный ChatGPT будет иметь представления о мире, полученные в результате его обучения на подмножестве источников интернета. Каждое такое подмножество будет отражать видение мира людьми с определенным мировоззрением. Например, «ChatGPT-демократ» будет давать другие ответы, чем «ChatGPT-республиканец», – говорит Хинтон.

Стоит ли говорить, что авторитетом будет пользоваться та ИИ-система, которая будет использовать установки, доминирующие в контролируемом той или иной стороной информационном пространстве? В условиях информационной войны российская ИИ-система должна быть не просто аналогом, а как минимум проецировать ценности и установки, принятые в российском обществе, с учетом нашего национального, культурного и религиозного многообразия. А сегодня мы даже до конца не понимаем возможности «Алисы» компании «Яндекс» (знали ли вы, что она тоже умеет рисовать картины?), которой россияне задают 18 миллионов вопросов каждый день.

Не стать рабами машины

Мы сталкиваемся с неизведанным вызовом, который человечеству только предстоит осмыслить. Делать это надо очень быстро. Технологии безусловно приносят в нашу жизнь удобство и комфорт, но цена этого слишком высока. Кажущийся удобным помощником ИИ-чат одномоментно может стать сначала незаменимым, а потом и неотъемлемым и неотчуждаемым атрибутом не только общественной, но и физиологической жизни человека. Как сказал философ Герберт Маркузе: «Машина – это раб, который служит тому, чтобы делать рабами других».

Сегодня человечество уже занесло в цифровую бездну одну ногу, но второй пока еще стоит на грешной земле, пошатываясь от собственной неуверенности. Задача всех думающих людей нашего времени представляется в том, чтобы максимально отсрочить срок этого падения, а лучше предотвратить его.

Алексей Васильев

На замену устаревшим ракетоносцам подойдет пассажирский Ту-214

Алексей Васильев

На замену устаревшим ракетоносцам подойдет пассажирский Ту-214